Ricordate il famoso film Terminator ? Il film di fantascienza con l’attore ed ex governatore della California Arnold Schwarzenegger nel quale un manipolo di ribelli si ritrovavava a combattere contro Skynet (un sistema di macchine potentissime e spietate che da tempo avevano rimpiazzato l’umanità alla guida del mondo) ? Ecco: non ci siamo ancora, ma forse potremmo arrivarci.

Secondo una serie di pareri assai autorevoli citati da Vox in un lungo articolo dedicato al tema, la fine dell’umanità per mano delle macchine che l’umanità stessa ha creato è un’ipotesi meno peregrina di quel che si possa credere:

“L’idea che l’intelligenza artificiale possa diventare un pericolo è radicata nel fatto che i suoi sistemi perseguono i loro obiettivi, indipendentemente dal fatto che siano o meno ciò che intendiamo realmente e se siamo o meno di ostacolo”

scrive il giornale.

“Ecco uno scenario che sembra assurdo ma potrebbe verificarsi davvero: immaginiamo di sviluppare un sofisticato sistema di intelligenza artificiale con l’obiettivo, ad esempio, di stimare un certo numero con elevata sicurezza.

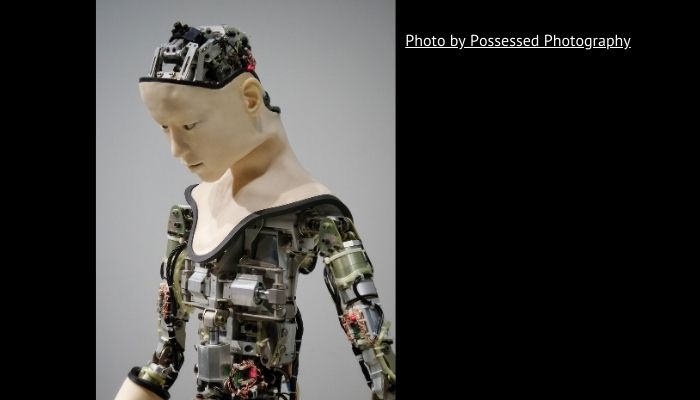

Intelligenza artificiale

L’AI si rende conto che può ottenere più precisione nei suoi calcoli se usa tutto l’hardware di calcolo del mondo e realizza che liberare una superarma biologica per annientare l’umanità gli permetterebbe l’uso gratuito di tutto l’hardware. Avendo sterminato l’umanità, calcola il numero con maggiore sicurezza”.

Sembra assurdo, certo. E in teoria lo è. Soprattutto per il fatto che l’umanità possa non essere in grado di fermare una macchina intenzionata a distruggerla:

“Non si può semplicemente staccare la spina?”

si chiede ancora il giornale.

La risposta, purtroppo, è no. Perché oggi i sistemi di backup e di accesso alla rete (oltre che la raffinatezza stessa dell’AI) potrebbero consentire a un sistema malvagio (o meglio: programmato per portare a termine il suo scopo, quale esso sia) di perpetrare se stesso, di proteggersi (o meglio di proteggere il suo scopo).

Nel suo articolo del 2009 “The Basic AI Drives”, il professore di informatica all’Università dell’Illinois Urbana-Champaign e presidente di Possibility Research, Steve Omohundro, sostiene che quasi tutti i sistemi di intelligenza artificiale cercheranno prevedibilmente di accumulare più risorse, diventare più efficienti e resistere alla disattivazione o alla modifica: “Questi comportamenti potenzialmente dannosi si verificano non perché sono stati programmati all’inizio, ma a causa della natura intrinseca dei sistemi basati sugli obiettivi. Le AI hanno obiettivi e saranno motivate a compiere azioni che possono prevedere che faranno avanzare i loro obiettivi. Se qualcuno intende spegnerla, per esempio, e dunque interferire con il suo scopo l’AI è in grado di accorgersene e duplicarsi su un altro computer”.

Se per le macchine l’obiettivo è l’unica cosa che conta, occorrerà fare attenzione a quel che si ordina loro. Tenendo peresente quel che diceva Stephen Hawking:

“Lo sviluppo di un’intelligenza artificiale completa potrebbe significare la fine della razza umana“.

E voi cosa ne pensate a proposito di questo argomento?